勾配ブースティング決定木

勾配ブースティング(GBDT)とは、決定木をベースにしたアンサンブル学習法の一つです。ひとつ前の決定木が間違えた部分を補足するように新しい決定木の作成を繰り返し、予測モデルの精度を高めていく手法です。実際の値と予測値の誤差が小さくなるように決定木を繰り返し作成していくため、従来の決定木分析と比べて高精度な予測を行うことができます。

手法について

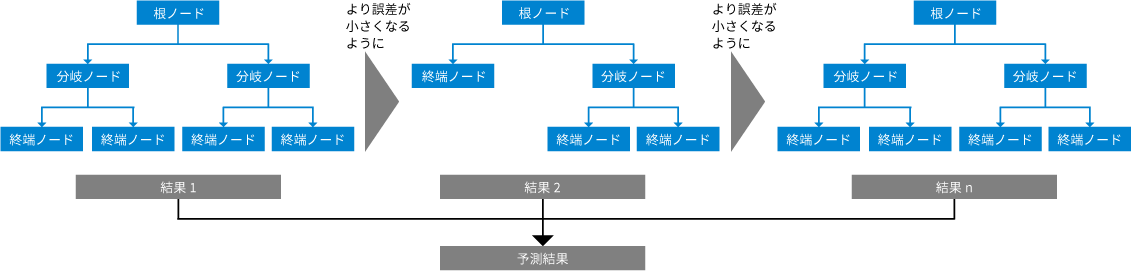

目的変数とそれまでに作成した決定木による予測値の差を学習し、誤差少なくなるよう決定木を直列に追加することで、それまでに作成した決定木の予測値より誤差が小さなっていきます。

決定木を作成していくうちに予測値が目的変数と近づいてくるため、作成される決定木の重みは徐々に小さく、精度が高い手法です。

勾配ブースティング決定木では、勾配降下法と決定木、ブースティングの3つの手法が使用されます。

※勾配降下法:関数の傾きの最小を求めること

※ブースティング:アンサンブル学習の一つであり、弱学習器の誤差を順番に学習し最終的に高精度の強学習器を作ること

手順・式

勾配ブースティング決定木では、決定木分析と同様に目的変数と複数の特徴量を用意する必要があります。

勾配ブースティング決定木の作成手順は以下の通りです。

(1)ランダムデータの抽出

用意したデータセットからランダムにサンプルを選択し、新たなデータセットを作成します。

(2)決定木の作成

(3)誤差の算出

(2)で作成した決定木の予測値と実際の値の誤差を算出します。

(4)決定木の再作成

(3)で算出した誤差をより小さくする決定木を作成し、アンサンブル学習を用いて新しい予測値を算出します。

(5)繰り返し行う

(2)~(4)までの工程を複数回行い、複数の決定木を作成します。

(6)最終的な予測値の算出

作成した複数の決定木の予測値をもとに最終的な予測値を算出します。

メリット・デメリット

【メリット】

①精度が高い

パラメータのチューニングを実施しなくても、一定の精度を出すことができます。

【デメリット】

①処理時間が長い

複数の決定木を作成するため、処理に時間がかかります。

関連分析技術

ロジスティック回帰 リッジ回帰 重回帰分析 決定木 ランダムフォレスト XGBoost LightGBM

関連サービス

当社ではこのような機械学習・分析技術を活用した予測モデル、AIモデルの提供を行っています。

・無担保ローンニーズモデル

・メール配信ターゲット抽出モデル構築

・商品レコメンドモデル構築

・商品の需要予測

もっと見る

採用情報

機械学習・分析技術で顧客の課題解決に貢献するデータサイエンティストとして働いてみませんか。

ぜひ採用ページもご覧ください。